Como otimizar a intralogística para simplificar e agilizar as cadeias de suprimentos da Indústria 4.0 - Parte dois de dois

Contributed By DigiKey's North American Editors

2023-09-22

A Parte 1 desta série sobre intralogística discutiu questões relacionadas a como os robôs móveis autônomos (AMRs) e os veículos guiados automatizados (AGVs) são usados em um nível de sistema para implementar a intralogística e movimentar materiais de forma rápida e segura, conforme necessário. Este artigo se concentra nos casos de uso e em como os AMRs e AGVs empregam sensores para identificar e rastrear itens, como o aprendizado de máquina (ML) e a inteligência artificial (AI) dão suporte à identificação de materiais, à movimentação e à entrega de materiais em armazéns e instalações de produção.

A intralogística (logística interna) usa robôs móveis autônomos (AMRs) e veículos guiados automatizados (AGVs) para movimentar materiais com eficiência em armazéns e instalações de produção da Indústria 4.0. Para simplificar e agilizar as cadeias de suprimentos, os sistemas de intralogística precisam saber a localização atual do material, o destino pretendido do material e o caminho mais seguro e eficiente para que o material chegue ao destino. Essa navegação simplificada exige uma diversidade de sensores.

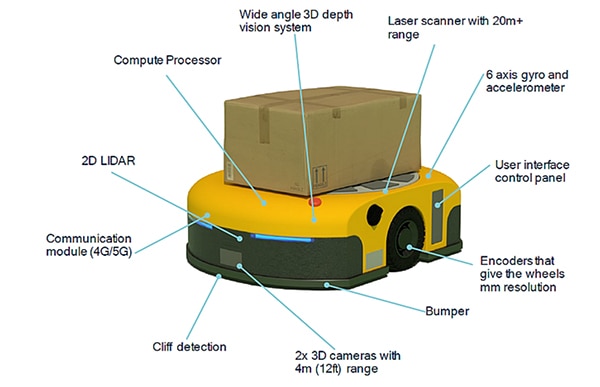

Nas soluções de intralogística, os AGVs e AMRs usam sensores para aumentar sua consciência situacional. Os conjuntos de sensores oferecem segurança para o pessoal próximo, proteção de outros equipamentos e navegação e localização eficientes. Dependendo dos requisitos da aplicação, as tecnologias de sensores para AMRs podem incluir sensores de contato, como chaves fim de curso integradas a para-choques, detecção e alcance de luz 2D e 3D (LiDAR), ultrassom, câmeras 2D e estéreo, radar, codificadores, unidades de medição inercial (IMUs) e fotocélulas. Para os AGVs, os sensores podem incluir sensores de linha magnéticos, indutivos ou ópticos, bem como chaves fim de curso integradas aos para-choques, LiDAR 2D e codificadores.

O primeiro artigo desta série aborda questões relacionadas a como os AMRs e AGVs são usados em um nível de sistema para implementar a intralogística e movimentar materiais com eficiência, conforme necessário.

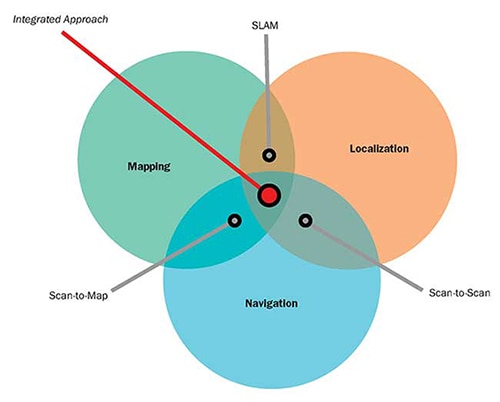

O foco deste artigo é a fusão de sensores e como os AMRs e AGVs empregam combinações de sensores, além de AI e ML para localização, navegação e segurança operacional. Ele começa com uma breve revisão dos sensores comuns encontrados em AGVs, examina a pose do robô e os algoritmos de localização e mapeamento simultâneos (SLAM) usando a fusão de sensores, considera como as estimativas de SLAM podem ser aprimoradas com técnicas de correspondência de varredura para mapa e de varredura para varredura e encerra com uma visão de como a fusão de sensores contribui para a operação segura de AMRs e AGVs. A DigiKey oferece suporte aos projetistas com uma ampla variedade de sensores e interruptores para robótica e outras aplicações industriais em todos esses casos.

Uma variedade de sensores e fusão de sensores, AI, ML e conectividade sem fio são necessários para dar suporte à operação autônoma e à segurança em AMRs. Embora as demandas de desempenho dos AGVs sejam menores, eles ainda dependem de vários sensores para suportar uma operação segura e eficiente. Há duas categorias abrangentes de sensores:

- Os sensores proprioceptivos medem valores internos do robô, como velocidade da roda, carga, carga da bateria e assim por diante.

- Os sensores exteroceptivos fornecem informações sobre o ambiente do robô, como medições de distância, localização de pontos de referência e identificação de obstáculos, como pessoas que entram no caminho do robô.

A fusão de sensores em AGVs e AMRs depende de combinações de sensores proprioceptivos e exteroceptivos. Exemplos de sensores em AMRs incluem (Figura 1):

- Scanner a laser para detecção de objetos com alcance de mais de 20 metros (m)

- IMU com um giroscópio e acelerômetro de 6 eixos e, às vezes, incluindo um magnetômetro

- Codificadores com resolução em milímetros (mm) nas rodas

- Sensor de contato como um microinterruptor no para-choque para interromper imediatamente o movimento se houver contato com um objeto inesperado

- Duas câmeras 3D com visão dianteira e alcance de 4 m

- Sensor voltado para baixo para detectar a borda de uma plataforma (chamada detecção de queda)

- Módulos de comunicação para fornecer conectividade e podem, opcionalmente, oferecer detecção de ângulo de chegada (AoA) e ângulo de partida (AoD) Bluetooth para serviços de localização em tempo real (RTLS) ou pontos de transmissão/pontos de recepção (TRP) 5G para traçar uma grade com precisão em nível de centímetro

- LiDAR 2D para calcular a proximidade de obstáculos à frente do veículo

- Sistema de visão com profundidade 3D de ângulo amplo adequado para identificação e localização de objetos

- Processador de computação de alto desempenho na placa para fusão de sensores, AI e ML

Figura 1: Exemplo de AMR mostrando a diversidade e as posições dos sensores incorporados. (Fonte da imagem: Qualcomm)

Figura 1: Exemplo de AMR mostrando a diversidade e as posições dos sensores incorporados. (Fonte da imagem: Qualcomm)

Pose do robô e fusão de sensores

A navegação AMR é um processo complexo. Uma das primeiras etapas é que o AMR saiba onde está e para qual direção está voltado. Essa combinação de dados é chamada de pose do robô. O conceito de pose também pode ser aplicado aos braços e aos efetuadores finais de robôs estacionários de vários eixos. A fusão de sensores combina entradas da IMU, codificadores e outros sensores para determinar a pose. O algoritmo de pose estima a posição (x, y) do robô e o ângulo de orientação θ, com relação aos eixos de coordenadas. A função q = (x, y, θ) define a pose do robô. Para as AMRs, as informações sobre a pose têm uma variedade de usos, inclusive:

- A pose de um intruso, como uma pessoa que entra perto do robô, em relação a um quadro de referência externo ou em relação ao robô

- A pose estimada do robô após se mover em uma determinada velocidade por um tempo predeterminado

- Cálculo do perfil de velocidade necessária para que o robô se mova de sua pose atual para uma segunda pose

A pose é uma função predefinida em vários ambientes de desenvolvimento de software para robôs. Por exemplo, o pacote robot_pose_ekf está incluído no Sistema Operacional de Robôs (ROS), uma plataforma de desenvolvimento de código aberto. O robot_pose_ekf pode ser usado para estimar a pose 3D de um robô com base em medições de pose (parciais) de vários sensores. Ele usa um filtro Kalman estendido com um modelo 6D (posição 3D e orientação 3D) para combinar medições do codificador para odometria de roda, uma câmera para odometria visual e a IMU. Como os vários sensores operam com taxas e latências diferentes, o robot_pose_ekf não exige que todos os dados do sensor estejam disponíveis de forma contínua ou simultânea. Cada sensor é usado para fornecer uma estimativa de pose com uma covariância. O robot_pose-ekf identifica as informações do sensor disponíveis em qualquer momento e faz os ajustes necessários.

Fusão de sensores e SLAM

Muitos ambientes em que os AMRs operam incluem obstáculos variáveis que podem se mover de tempos em tempos. Embora um mapa básico da instalação seja útil, é necessário mais. Ao se movimentar em uma instalação industrial, os AMRs precisam de mais do que informações de posicionamento; eles também empregam SLAM para garantir uma operação eficiente. O SLAM adiciona mapeamento do ambiente em tempo real para dar suporte à navegação. Há duas abordagens básicas para o SLAM:

- SLAM visual que emparelha uma câmera com uma IMU

- SLAM LiDAR que combina um sensor a laser, como o LiDAR 2D ou 3D, com uma IMU

O SLAM LiDAR pode ser mais preciso do que o SLAM visual, mas sua implementação geralmente é mais cara. Como alternativa, o 5G pode ser usado para fornecer informações de localização para aprimorar as estimativas do SLAM visual. O uso de redes 5G privadas em armazéns e fábricas pode aumentar os sensores incorporados para SLAM. Alguns AMRs implementam o posicionamento preciso em ambientes internos usando pontos de transmissão/recepção (TRP) 5G para traçar uma grade com precisão de centímetros nos eixos x, y e z.

A navegação bem-sucedida depende da capacidade do AMR de se adaptar às mudanças nos elementos ambientais. A navegação combina SLAM visual e/ou SLAM LiDAR, tecnologias de sobreposição, como TRP 5G, e ML para detectar alterações no ambiente e fornecer atualizações constantes de localização. A fusão de sensores oferece suporte ao SLAM de várias maneiras:

- Atualizações contínuas do modelo espacial e semântico do ambiente com base nas entradas de vários sensores usando AI e ML

- Identificação de obstáculos, permitindo assim que os algoritmos de planejamento de itinerário façam os ajustes necessários e encontrem o caminho mais eficiente no ambiente

- Implementação do plano de itinerário, exigindo controle em tempo real para alterar o caminho planejado, incluindo a velocidade e a direção do AMR, conforme o ambiente muda

Quando o SLAM não é suficiente

O SLAM é uma ferramenta essencial para a navegação AMR eficiente, mas o SLAM sozinho é insuficiente. Assim como os algoritmos de pose, o SLAM é implementado com um filtro de Kalman estendido que fornece valores estimados. Os valores estimados pelo SLAM ampliam os dados de pose, adicionando velocidades lineares e rotacionais e acelerações lineares, entre outros. A estimativa do SLAM é um processo de duas etapas; a etapa inicial envolve a compilação de previsões usando a análise do sensor interno com base nas leis físicas do movimento. A etapa restante da estimativa do SLAM exige leituras de sensores externos para refinar as estimativas iniciais. Esse processo em duas etapas ajuda a eliminar e corrigir pequenos erros que podem se acumular com o tempo e criar erros significativos.

O SLAM depende da disponibilidade de entradas de sensores. Em alguns casos, o LiDAR 2D de custo relativamente baixo pode não funcionar, por exemplo, se não houver objetos na linha de visão direta do sensor. Nesses casos, as câmeras estéreo 3D ou o LiDAR 3D podem melhorar o desempenho do sistema. No entanto, as câmeras estéreo 3D ou o LiDAR 3D são mais caros e exigem mais poder de computação para a implementação.

Outra alternativa é usar um sistema de navegação que integre o SLAM com técnicas de correspondência de varredura para mapa e de varredura para varredura que podem ser implementadas usando apenas sensores LiDAR 2D (Figura 2):

- A correspondência de varredura para mapa usa os dados de alcance do LiDAR para estimar a posição do AMR, fazendo a correspondência das medições de alcance com um mapa armazenado. A eficácia desse método depende da precisão do mapa. Ele não sofre desvios ao longo do tempo, mas, em ambientes repetitivos, pode resultar em erros difíceis de identificar, causar mudanças descontínuas na posição percebida e ser difícil de eliminar.

- A correspondência de varredura para varredura usa dados sequenciais de alcance do LiDAR para estimar a posição de um AMR entre varreduras. Esse método fornece informações atualizadas de localização e pose para o AMR, independentemente de qualquer mapa existente, e pode ser útil durante a criação do mapa. No entanto, trata-se de um algoritmo incremental que pode estar sujeito a desvios ao longo do tempo, sem a capacidade de identificar as imprecisões introduzidas por esses desvios.

Figura 2: Os algoritmos de correspondência de varredura para mapa e varredura para varredura podem ser usados para complementar e melhorar o desempenho dos sistemas SLAM. (Fonte da imagem: Aethon)

Figura 2: Os algoritmos de correspondência de varredura para mapa e varredura para varredura podem ser usados para complementar e melhorar o desempenho dos sistemas SLAM. (Fonte da imagem: Aethon)

A segurança precisa da fusão de sensores

A segurança é uma das principais preocupações dos AGVs e AMRs, e vários padrões devem ser considerados. Por exemplo, American National Standards Institute / Industrial Truck Standards Development Foundation (ANSI/ITSDF) B56.5 - 2019, Safety Standard for Driverless, Automatic Guided Industrial Vehicles and Automated Functions of Manned Industrial Vehicles, ANSI / Robotic Industrial Association (RIA) R15.08-1-2020 - Standard for Industrial Mobile Robots - Safety Requirements, vários padrões da International Standards Organization (ISO), entre outros.

A operação segura de AGVs e AMRs exige a fusão de sensores que combina sensores LiDAR 2D com certificados de segurança (às vezes chamados de scanners a laser de segurança) com codificadores nas rodas. O LiDAR 2D suporta simultaneamente duas distâncias de detecção, pode ter um ângulo de detecção de 270° e coordenadas com a velocidade do veículo informada pelos codificadores. Quando um objeto é detectado na zona de detecção mais distante (até 20 m de distância, dependendo do sensor), o veículo pode ser desacelerado conforme necessário. Se o objeto entrar na zona de detecção mais próxima na linha de deslocamento, o veículo para de se mover.

Os scanners a laser de segurança são geralmente usados em conjuntos de 4, com um colocado em cada canto do veículo. Eles podem operar como uma única unidade e se comunicar diretamente com o controlador de segurança do veículo. Os scanners estão disponíveis e certificados para uso em aplicações de Categoria de Segurança 3, Nível de Desempenho d (PLd) e Nível de Integridade de Segurança 2 (SIL2) e estão alojados em um gabinete IP65 adequado para a maioria das aplicações externas e internas (Figura 3). Os scanners incluem uma entrada para informações incrementais do codificador das rodas para dar suporte à fusão de sensores.

Figura 3: Sensores lidar 2D como esse podem ser combinados com codificadores nas rodas em um sistema de fusão de sensores que proporciona uma operação segura de AMRs e AGVs. (Fonte da imagem: Idec)

Figura 3: Sensores lidar 2D como esse podem ser combinados com codificadores nas rodas em um sistema de fusão de sensores que proporciona uma operação segura de AMRs e AGVs. (Fonte da imagem: Idec)

Conclusão

A intralogística dá suporte a cadeias de suprimentos mais rápidas e eficientes em armazéns e fábricas da Indústria 4.0. Os AMRs e AGVs são ferramentas importantes para a intralogística, para movimentar materiais de um lugar para outro de maneira oportuna e segura. A fusão de sensores é necessária para dar suporte às funções do AMR e do AGV, incluindo a determinação da pose, o cálculo dos dados do SLAM, o aprimoramento do desempenho da navegação usando a correspondência de varredura para mapa e de varredura para varredura, além de garantir a segurança do pessoal e dos objetos em toda a instalação.

Disclaimer: The opinions, beliefs, and viewpoints expressed by the various authors and/or forum participants on this website do not necessarily reflect the opinions, beliefs, and viewpoints of DigiKey or official policies of DigiKey.